Потужніший за Meta та OpenAI: китайський стартап DeepSeek презентував ШІ-модель

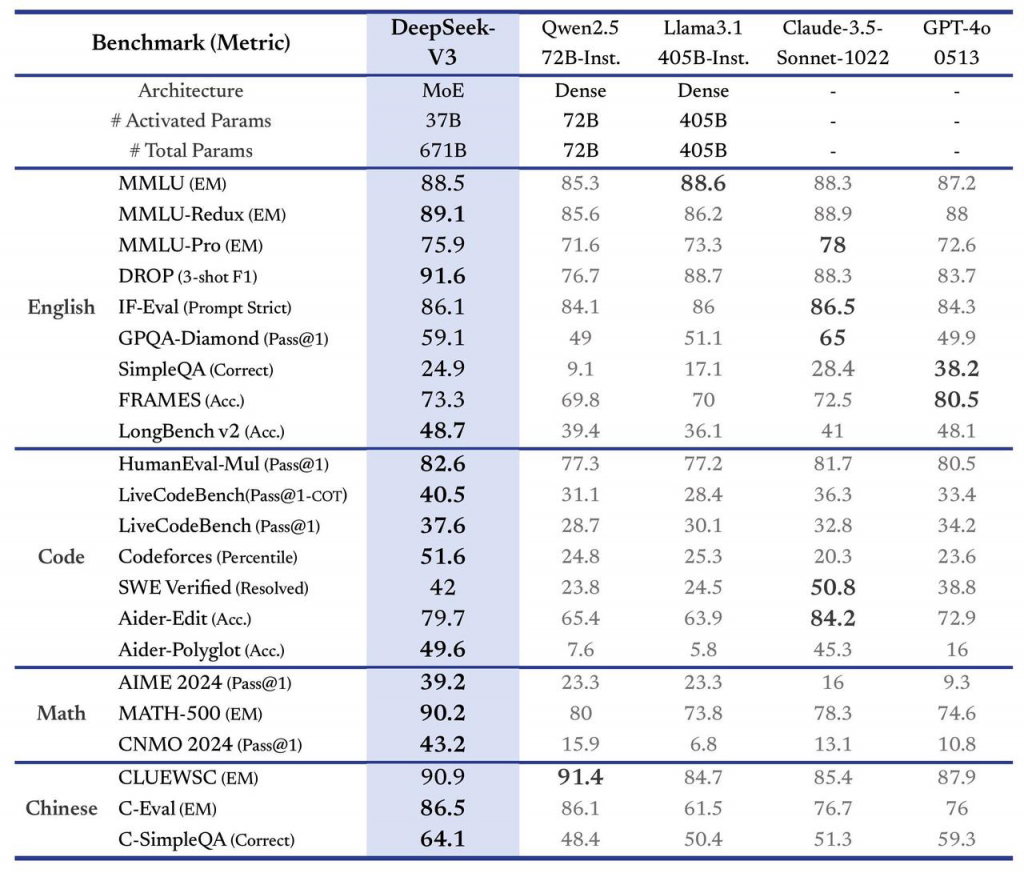

Китайський ШІ-стартап DeepSeek представив власну велику мовну модель, яка перевершила за тестами конкурентів від Meta та OpenAI.

🚀 Introducing DeepSeek-V3!

— DeepSeek (@deepseek_ai) December 26, 2024

Biggest leap forward yet:

⚡ 60 tokens/second (3x faster than V2!)

💪 Enhanced capabilities

🛠 API compatibility intact

🌍 Fully open-source models & papers

🐋 1/n pic.twitter.com/p1dV9gJ2Sd

DeepSeek V3 має 671 млрд параметрів. Для порівняння, у Llama 3.1 405B показник 405 млрд. Число відображає здатність ШІ адаптуватися до більш складних варіантів застосування і давати відповіді точніше.

Компанія з Ханчжоу навчила нейромережу за два місяці та $5,58 млн, використовуючи значно менше обчислювальних ресурсів (2048 графічних процесорів) порівняно з більшими технологічними компаніями. Вона обіцяє надання кращого співвідношення ціна/якість на ринку.

💰 API Pricing Update

— DeepSeek (@deepseek_ai) December 26, 2024

🎉 Until Feb 8: same as V2!

🤯 From Feb 8 onwards:

Input: $0.27/million tokens ($0.07/million tokens with cache hits)

Output: $1.10/million tokens

🔥 Still the best value in the market!

🐋 3/n pic.twitter.com/OjZaB81Yrh

У майбутньому заплановано додавання мультимодальності та «інших передових функцій».

Член команди OpenAI Андрій Карпаті зазначив, що DeepSeek продемонструвала вельми дивовижні дослідження і розробки в умовах обмежених ресурсів.

DeepSeek (Chinese AI co) making it look easy today with an open weights release of a frontier-grade LLM trained on a joke of a budget (2048 GPUs for 2 months, $6M).

— Andrej Karpathy (@karpathy) December 26, 2024

For reference, this level of capability is supposed to require clusters of closer to 16K GPUs, the ones being… https://t.co/EW7q2pQ94B

«Чи означає це, що вам не потрібні великі кластери GPU для прикордонних LLM? Ні, але ви повинні бути впевнені, що не витрачаєте те, що у вас є. Це виглядає як хороша демонстрація того, що ще багато чого належить зробити як з даними, так і з алгоритмами», — додав він.

Раніше DeepSeek представила «конкурента o1 від OpenAI» — розумну «надпотужну» ШІ-модель DeepSeek-R1-Lite-Preview.

Нагадаємо, у липні китайська компанія Kuaishou відкрила ШІ-модель для генерації відео Kling для всіх охочих.